成為卓越且可持續的AI解決方案提供商,豐富每個人的生活

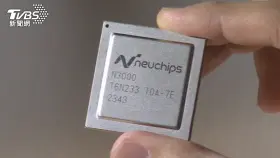

自2019年Neuchips成立以來,我們的業務涵蓋從 7 奈米 ASIC 設計、高速 PCIe 推論卡工程,到大規模資料中心的整合方案。憑藉 N3000 架構,我們在深度學習推薦模型(DLRM)上實現了 2.2 倍的效能功耗比提升,為節能且全棧式的 AI 創新提供不可或缺的「以晶片為核心的 DNA」。

創鑫智慧的整合軟體架構將我們的AI ASIC硬體與全面的軟體解決方案相結合。從底層的AI ASIC和作業系統驅動程式開始,我們的堆疊包含優化的編譯器和機器學習框架,與創鑫智慧引擎協同工作。我們支援主流的預訓練AI模型,如Llama和Mistral等,並配備使用者友善的應用程式介面和管理工具,實現無縫部署。

人工智慧軟體技術架構

生成式AI推論晶片

矽智財IP

矽智財IP

隨著 AI 產業趨向高度客製化,創鑫智慧已正式轉型為全方位的策略合作夥伴,致力於提供尖端的矽智財(IP)授權與設計服務。我們協助客戶在瞬息萬變的 AI 市場中,快速開發出具競爭力的特定應用積體電路(Application-Specific Integrated Circuit, ASIC)。

生成式AI推論卡

解決方案

解決方案

我們的全面解決方案整合了尖端硬體與強大的軟體元件,打造一個完整的端對端系統,旨在加速人工智慧的採用。這種無痛升級的硬體-軟體整合突破了落地障礙,促使人工智慧應用能夠在各行業中快速部署。

隨著生成式 AI 應用從雲端走向企業內部,對資安與效能的需求日益增長。在資策會台日產業合作推動中心 (TJIC) 的支持與扶持下,創鑫智慧 (Neuchips)、展嘉科技 (Netiotek) 與 思銳智慧 (ShareGuru) 聯手合作,共同推出整合 AI 加速卡、邊緣運算主機與知識問答系統的在地部署解決方案。

在生成式 AI 邁向企業級應用的關鍵時刻,創鑫智慧 (Neuchips)、國研院國網中心 (NCHC) 與思銳智慧 (ShareGuru) 攜手展開深度技術合作。透過國家級算力平台與國產自研硬體的無縫整合,為企業提供高效、低延遲的 AI 落地解決方案。

Viper LLM 推論卡 內建 Raptor N3000 晶片,領銜打造企業專屬、安全、高效的 MINI SERVER 知識服務體系

全球AI推論加速晶片廠商創鑫智慧(Neuchips) 執行長劉景慈今(15)日宣佈,將於5月20至23日台北國際電腦展(COMPUTEX 2025) 會場展示革命性的N3000晶片系列及Viper PCIe加速卡,預期將為生成式AI中大型語言模型(LLM)推論應用,帶來突破性的能源效率,是專為地端部署設計的成本效益方案。

隨著生成式 AI 應用從雲端走向企業內部,對資安與效能的需求日益增長。在資策會台日產業合作推動中心 (TJIC) 的支持與扶持下,創鑫智慧 (Neuchips)、展嘉科技 (Netiotek) 與 思銳智慧 (ShareGuru) 聯手合作,共同推出整合 AI 加速卡、邊緣運算主機與知識問答系統的在地部署解決方案。

在生成式 AI 邁向企業級應用的關鍵時刻,創鑫智慧 (Neuchips)、國研院國網中心 (NCHC) 與思銳智慧 (ShareGuru) 攜手展開深度技術合作。透過國家級算力平台與國產自研硬體的無縫整合,為企業提供高效、低延遲的 AI 落地解決方案。

Viper LLM 推論卡 內建 Raptor N3000 晶片,領銜打造企業專屬、安全、高效的 MINI SERVER 知識服務體系

全球AI推論加速晶片廠商創鑫智慧(Neuchips) 執行長劉景慈今(15)日宣佈,將於5月20至23日台北國際電腦展(COMPUTEX 2025) 會場展示革命性的N3000晶片系列及Viper PCIe加速卡,預期將為生成式AI中大型語言模型(LLM)推論應用,帶來突破性的能源效率,是專為地端部署設計的成本效益方案。

生成式AI推升算力需求暴增,從雲端資料中心到企業內部伺服器,如何以更少能耗支撐大型語言模型(LLM)推論,成為硬體研發新戰場。成立於2019年的創鑫智慧,源自清華大學育成中心,以「用最少電力達到最佳效能」為使命,專注於低功耗AI晶片與推論加速卡的設計與整合。

日前MLCommons公布最新人工智慧(AI)晶片評測結果,來自台灣的創鑫智慧,在做為推薦用途的AI推論(inference)晶片,每瓦處理次數上超越輝達(nVidia),這是台灣IC設計業者很少見超越世界一流大廠的成績,而且創鑫智慧成立於2019年,是一家創業才四年的小型IC設計公司,如何做到這項成就,相當引人關注。

創鑫智慧的人工智慧(AI)晶片在國際評比中表現亮眼,創辦人暨董事長林永隆此前受訪時表示,團隊開發的晶片可加速資料中心、社群平台的推薦模型(Recommendation model)效能,並採台積電7奈米製程生產,目前已完成工程驗證,陸續開發客戶中。

生成式AI推升算力需求暴增,從雲端資料中心到企業內部伺服器,如何以更少能耗支撐大型語言模型(LLM)推論,成為硬體研發新戰場。成立於2019年的創鑫智慧,源自清華大學育成中心,以「用最少電力達到最佳效能」為使命,專注於低功耗AI晶片與推論加速卡的設計與整合。

日前MLCommons公布最新人工智慧(AI)晶片評測結果,來自台灣的創鑫智慧,在做為推薦用途的AI推論(inference)晶片,每瓦處理次數上超越輝達(nVidia),這是台灣IC設計業者很少見超越世界一流大廠的成績,而且創鑫智慧成立於2019年,是一家創業才四年的小型IC設計公司,如何做到這項成就,相當引人關注。

創鑫智慧的人工智慧(AI)晶片在國際評比中表現亮眼,創辦人暨董事長林永隆此前受訪時表示,團隊開發的晶片可加速資料中心、社群平台的推薦模型(Recommendation model)效能,並採台積電7奈米製程生產,目前已完成工程驗證,陸續開發客戶中。

為加速生成式 AI 在台灣產業的實際應用,創鑫智慧 (Neuchips) 今日宣佈,正式啟動與 國家實驗研究院國家高速網路與計算中心(以下簡稱國研院國網中心) 的深度合作計畫。本次專案依託國研院國網中心發展的 TAIWAN AI RAP平台,結合創鑫智慧高能效 AI 推論技術,旨在為企業提供一套可快速部署、成本低廉且具備高度資料保密性的「地端生成式 AI 落地方案」。

隨著全球 AI 能源需求激增,創鑫智慧展示突破性的高能效技術,能夠在單一 AI 卡上以僅 45W 功耗運行 140 億參數模型。

為加速生成式 AI 在台灣產業的實際應用,創鑫智慧 (Neuchips) 今日宣佈,正式啟動與 國家實驗研究院國家高速網路與計算中心(以下簡稱國研院國網中心) 的深度合作計畫。本次專案依託國研院國網中心發展的 TAIWAN AI RAP平台,結合創鑫智慧高能效 AI 推論技術,旨在為企業提供一套可快速部署、成本低廉且具備高度資料保密性的「地端生成式 AI 落地方案」。

隨著全球 AI 能源需求激增,創鑫智慧展示突破性的高能效技術,能夠在單一 AI 卡上以僅 45W 功耗運行 140 億參數模型。